「Keras」の「Dense」と「TimeDistributedDense」の違い

回答:

行700列の時系列データがあり、Kerasのレイヤーにフィードするとします。それをRNNにフィードする前に、以前のデータを3Dテンソルに変形する必要があります。したがって、N × 700 × 1になります。SimpleRNN(200, return_sequence=True)

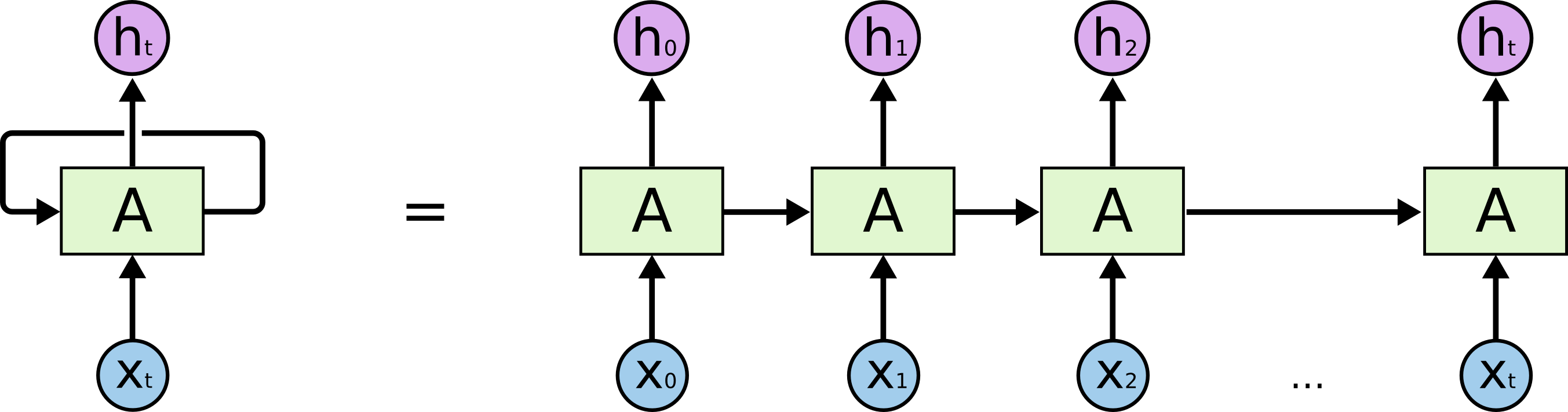

画像はhttps://colah.github.io/posts/2015-08-Understanding-LSTMsから取得されます

TimeDistributedDenseDenseDense

なぜこれを行うのですか?RNN出力をフラット化したくないためです。

RNN出力をフラット化しないのはなぜですか?各タイムステップ値を個別に保持する必要があるためです。

各タイムステップ値を別々に保つのはなぜですか?なぜなら:

- 独自のタイムステップ間で値をやり取りしたいだけです

- 異なるタイムステップとチャンネル間でランダムなやり取りをしたくありません。

そして、TimeDistributedDenseを適用すると、各タイムステップに密なレイヤーが適用されます->これは、各タイムステップが密なレイヤーの重みを共有するということですか?高密度レイヤーでは、最後のタイムステップにのみ適用されませんか?

—

o0omycomputero0o

なぜTimeDistributedDenseでKerasの例で使用されていないされていないblog.keras.io/...?

—

user1934212

TimeDistributedDenseはすでに廃止されているためです。Keras 2.0以降、Denseは2次元以上のテンソルをうまく処理できます

—

rilut